Un nouveau papier de recherche (arXiv 2512.24601) propose une approche différente pour gérer des contextes extrêmement longs. Au lieu d’ingérer l’intégralité d’un document ou d’une base de code dans la fenêtre de contexte d’un modèle, les “Recursive Language Models” (RLMs) traitent le texte comme un environnement externe, navigable par code.

L’objectif est de contourner la dégradation de performance observée sur les modèles actuels lorsqu’ils sont saturés d’informations, tout en offrant une méthode plus fiable pour des tâches complexes comme l’analyse de dossiers juridiques ou la maintenance de codebases volumineuses.

Le problème du “context rot”

Les grands modèles de langage (LLM) modernes affichent des fenêtres de contexte impressionnantes, atteignant parfois plusieurs millions de tokens (l’unité de texte traitée par le modèle). Cependant, leur capacité à exploiter efficacement cette masse d’informations diminue avec la longueur.

Ce phénomène, appelé “context rot” (pourrissement du contexte), se manifeste par des oublis, des hallucinations ou une incapacité à retrouver des détails précis noyés dans le volume. Sur des tests de type “needle-in-a-haystack” (retrouver une info précise dans une botte de foin), la précision peut chuter drastiquement au-delà d’un certain seuil, rendant l’exploitation de documents très longs risquée pour des applications critiques.

Ce que proposent les Recursive Language Models

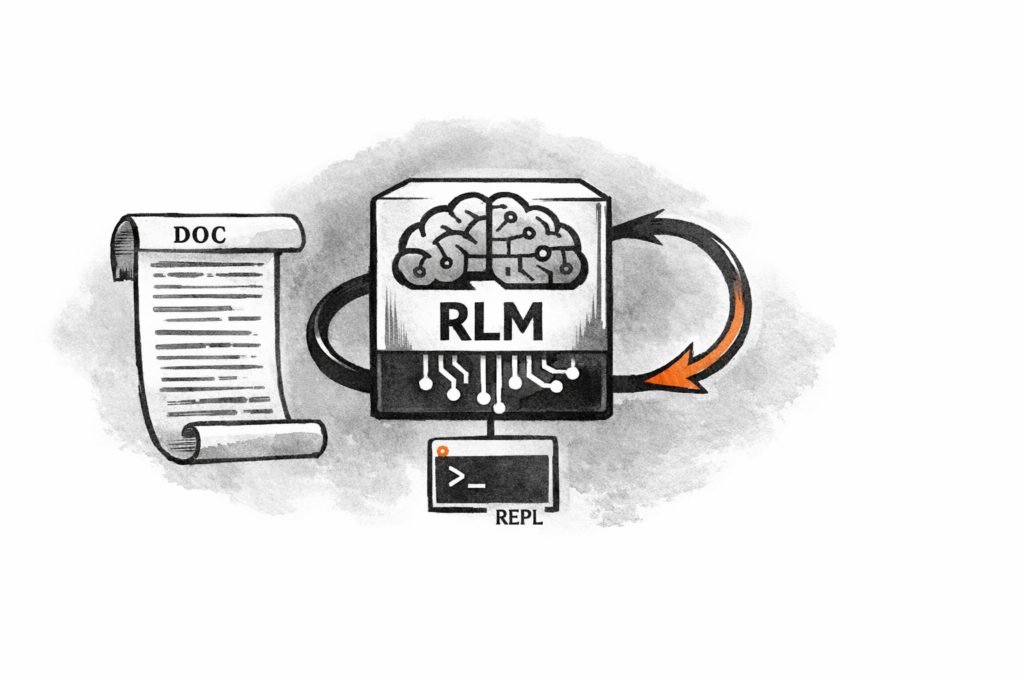

Les RLMs ne cherchent pas à agrandir la fenêtre de contexte. Ils changent la méthode d’accès à l’information. Le principe est de laisser le document long à l’extérieur du modèle, stocké dans une variable accessible par programmation.

Le modèle principal agit alors comme un chef d’orchestre : il génère du code pour découper ce contexte, l’analyser morceau par morceau, et peut s’appeler lui-même (récursivement) ou appeler d’autres modèles plus petits pour traiter chaque segment. Le terme “récursif” désigne ici cette capacité du modèle à diviser un problème en sous-problèmes identiques, qu’il résout en réutilisant sa propre logique à une échelle plus petite.

Comment ça marche en pratique

Concrètement, l’architecture repose sur un environnement d’exécution de code (REPL Python). Face à une tâche complexe, comme “résumer les risques dans ces 500 pages de contrats”, le modèle ne lit pas tout d’un coup.

Il adopte une stratégie programmatique :

- Partition : Il écrit un script pour découper le texte en segments (chunks) de taille gérable (ex: 50 pages).

- Délégation : Il lance des appels à des sous-modèles pour analyser chaque segment en parallèle.

- Agrégation : Il récupère les résultats structurés et les synthétise pour formuler la réponse finale.

Cette approche permet de traiter des volumes d’information théoriquement illimités sans jamais saturer la mémoire immédiate du modèle qui effectue le raisonnement final.

Cas d’usage et premiers résultats

Cette méthode vise spécifiquement les tâches qui nécessitent une lecture exhaustive et structurée, là où la recherche par mots-clés (RAG classique) ou la lecture linéaire échouent. Les cas d’usage naturels incluent l’audit de codebases entières, l’analyse de dossiers médicaux historiques ou la revue de diligence raisonnable (due diligence) en droit.

Les premiers résultats présentés dans le papier indiquent que cette méthode maintient une performance stable quelle que soit la longueur du document, évitant la courbe de dégradation typique des modèles à contexte long natif. Des implémentations expérimentales circulent déjà, notamment autour d’outils de développement assisté par IA.

Les compromis : latence et complexité

Cette fiabilité accrue a un coût. L’exécution de multiples appels successifs ou parallèles prend plus de temps qu’une inférence unique. La latence rend l’approche inadaptée pour des interactions en temps réel (chat). De plus, le coût financier (en tokens consommés) peut être supérieur, car chaque segment est traité individuellement.

L’orchestration demande aussi une infrastructure plus complexe qu’un simple appel API : il faut un environnement sécurisé pour exécuter le code généré et gérer les erreurs si le modèle produit un script invalide. Enfin, les modèles actuels (GPT-4, Claude 3.5) n’ont pas été spécifiquement entraînés pour agir comme ces “chefs d’orchestre”, ce qui peut conduire à des stratégies de découpage parfois inefficaces.

Ce qu’il faut retenir

Les Recursive Language Models formalisent une alternative crédible à la course sans fin vers des fenêtres de contexte toujours plus grandes. Ils marquent un retour à une approche plus “informatique” de l’IA, où le modèle ne se contente pas de lire, mais exécute activement une stratégie de traitement de l’information.

Si l’approche est encore au stade de la recherche, elle s’aligne avec une tendance de fond pour 2026 : l’augmentation de la puissance de raisonnement au moment de l’inférence (inference-time compute) pour résoudre des tâches lourdes que les modèles standards ne peuvent pas traiter fiablement en une seule passe.

Sources :